اخلاق هوش مصنوعی: ایجاد تعادل بین نوآوری و مسئولیت

هوش مصنوعی این قدرت را دارد که دنیایی را که ما در آن زندگی می کنیم متحول کند. از دستیارهای مجازی گرفته تا خودروهای خودران، هوش مصنوعی صنعت را متحول کرده و زندگی روزمره ما را بهبود می بخشد. با این حال، با فراگیرتر شدن هوش مصنوعی، باید پیامدهای اخلاقی توسعه و استقرار آن را در نظر بگیریم.

اخلاق هوش مصنوعی چیست؟

اخلاق مجموعه ای از اصول است که به ما کمک می کند درست را از نادرست تشخیص دهیم. وقتی صحبت از هوش مصنوعی می شود، دستورالعمل های اخلاقی برای مشاوره در مورد طراحی و نتایج آن وجود دارد. با این حال، انسانها سوگیریهای شناختی ذاتی دارند که میتواند در رفتارها و دادههای ما نشان داده شود، که میتواند توسط هوش مصنوعی با سرعت بیسابقهای تقویت و مقیاسپذیر شود.

با ظهور کلان داده ها، شرکت ها به طور فزاینده ای بر اتوماسیون رانندگی و تصمیم گیری مبتنی بر داده متمرکز شده اند. با این حال، طراحی ضعیف تحقیق و توسعه و مجموعه دادههای مغرضانه منجر به پیامدهای ناخواسته و نتایج ناعادلانه شده است.

برای رسیدگی به نگرانیها در مورد اخلاق هوش مصنوعی، دستورالعملهای جدیدی عمدتاً از جوامع تحقیقاتی و علوم داده پدید آمده است. شرکت های پیشرو در زمینه هوش مصنوعی نیز به دلیل عواقب ناشی از عدم رعایت استانداردهای اخلاقی، به شکل دادن به این دستورالعمل ها علاقه نشان داده اند. تمام پیشرفت های تکنولوژیکی، نوآوری اغلب از مقررات دولتی پیشی می گیرد. با این حال، با توسعه تخصص مناسب، می توان انتظار داشت پروتکل های هوش مصنوعی بیشتری برای جلوگیری از نقض حقوق بشر و آزادی های مدنی وجود داشته باشد.

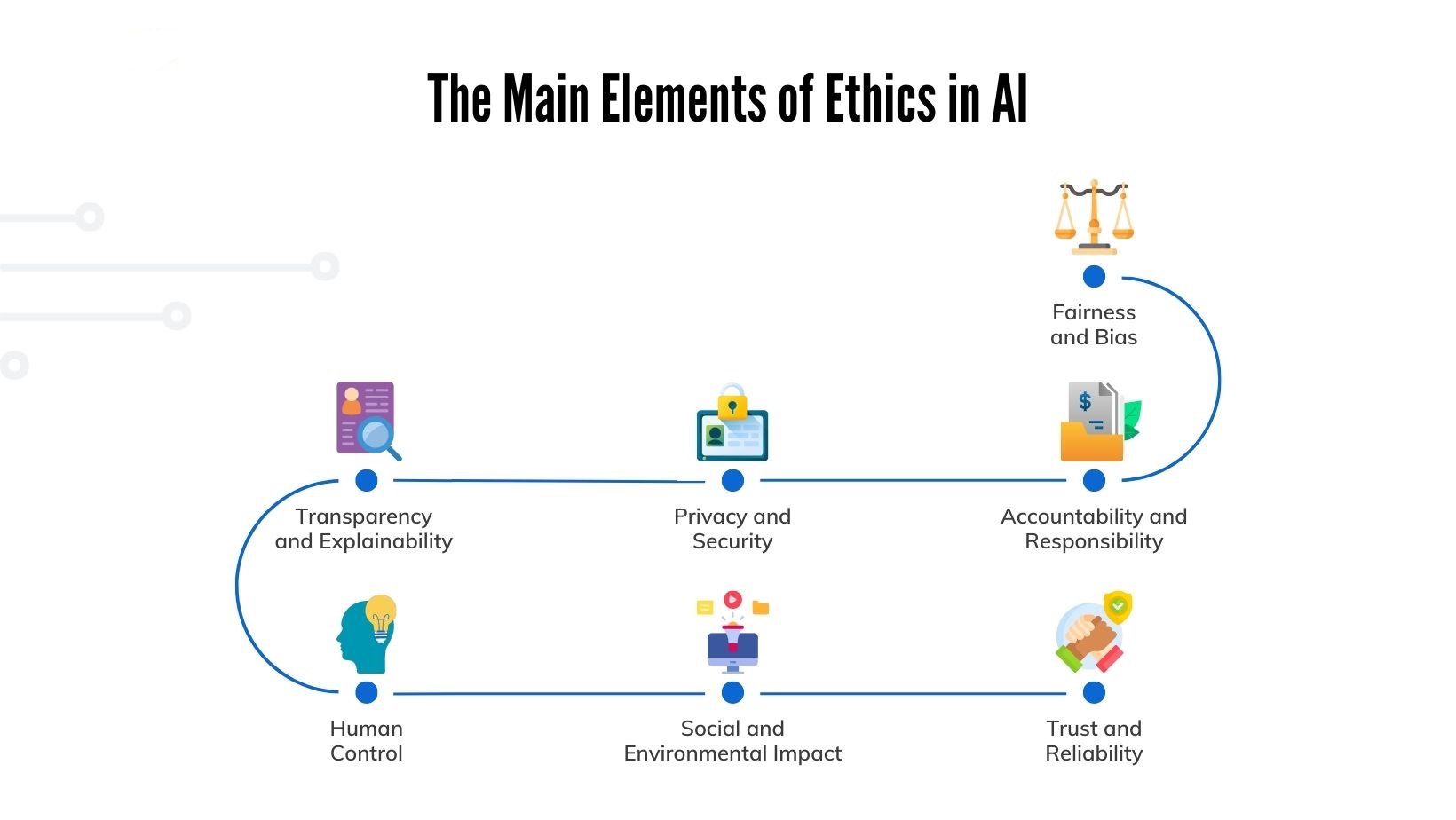

عناصر اصلی اخلاق در هوش مصنوعی برای اطمینان از توسعه و استفاده از هوش مصنوعی به گونهای که اخلاقی و مسئولیتپذیر باشد، حیاتی است. در ادامه این عناصر را با جزئیات بیشتری بررسی کنیم.

انصاف و تعصب

اطمینان از انصاف و کاهش سوگیری از اجزای حیاتی هوش مصنوعی اخلاقی است. سیستمهای هوش مصنوعی به اندازه دادههایی که روی آنها آموزش دیدهاند بیطرف هستند و سوگیریهای غیرعمدی میتوانند به سیستم نفوذ کنند. برای تضمین اینکه سیستمهای هوش مصنوعی به شیوهای عادلانه توسعه مییابند، مهم است که تنوع دادههای مورد استفاده برای آموزش سیستم و انجام تست سوگیری در مرحله توسعه را در نظر بگیریم.

مطالعات به طور نگران کننده ای نشان می دهد که فناوری تشخیص چهره می تواند علیه قومیت ها و جنسیت های خاص تعصب داشته باشد. به عنوان مثال، یک مطالعه نشان داد که فناوری تشخیص چهره زنان سیاهپوست را به میزان ۳۵ درصد به اشتباه شناسایی میکند، در حالی که تنها در ۱ درصد از مردان سفیدپوست اشتباه میکنند. برای مبارزه با این، برخی از شرکتها مجموعه دادههای متنوعتری را برای آموزش الگوریتمهای تشخیص چهره و آزمایش دقیق سوگیری در طول توسعه ایجاد میکنند. این گامی حیاتی در جهت تضمین انصاف و برابری در سیستمهای هوش مصنوعی است و ما باید به اولویتبندی این تلاشها ادامه دهیم.

شفافیت و توضیح پذیری

وقتی صحبت از هوش مصنوعی می شود، شفافیت و توضیح پذیری بعنوان ملاحظات اخلاقی حیاتی هستند. با پیچیده تر شدن سیستم های هوش مصنوعی، بسیار مهم است که ذینفعان بتوانند نحوه تصمیم گیری را درک کنند. در زمینههایی مانند مراقبتهای بهداشتی، که در آن هوش مصنوعی برای تصمیمگیریهای حیاتی که میتواند به معنای مرگ یا زندگی باشد، استفاده میشود، اولویت دادن به شفافیت و توضیحپذیری بسیار مهمتر است.

توسعه دهندگان باید به طور کامل فرآیند تصمیم گیری را مستندسازی کنند و به ذینفعان دسترسی به این اطلاعات را فراهم کنند. خوشبختانه، شرکتهایی مانند گوگل و مایکروسافت در ایجاد ابزارهایی پیشرو هستند که به کاربران کمک میکند بفهمند سیستمهای هوش مصنوعی چگونه به تصمیمهای خود میرسند. با شفافتر و قابل توضیحتر کردن هوش مصنوعی، میتوانیم به این فناوری اعتماد ایجاد کنیم و نگرانیها در مورد تأثیرات منفی احتمالی آن را کاهش دهیم. در نهایت، این یک گام ضروری برای ایجاد آینده ای است که در آن هوش مصنوعی به روشی مثبت و معنادار به بشریت خدمت می کند.

حریم خصوصی و امنیت

حریم خصوصی و امنیت جنبه های اساسی هوش مصنوعی اخلاقی هستند. با توجه به اینکه سیستمهای هوش مصنوعی برای تصمیمگیری به دادههای شخصی وابسته هستند، محافظت از این اطلاعات در برابر دسترسی غیرمجاز یا استفاده مخرب بسیار مهم است. علاوه بر این، سیستمهای هوش مصنوعی میتوانند در معرض خطرات امنیتی مانند هک قرار بگیرند که به طور بالقوه منجر به بهرهبرداری از دادههای شخصی و سایر نتایج نامطلوب میشود.

برای تضمین حریم خصوصی و امنیت، توسعه دهندگان باید اقدامات امنیتی قوی، از جمله رمزگذاری و کنترل های دسترسی، برای محافظت از داده های حساس را اجرا کنند. علاوه بر این، سیستمهای هوش مصنوعی باید نگرانیهای مربوط به حریم خصوصی را از ابتدای طراحی خود در اولویت قرار دهند و کاربران باید از نحوه استفاده از دادههایشان مطلع باشند. با اولویت دادن به حریم خصوصی و امنیت در هوش مصنوعی، میتوانیم فناوری مسئولانه و قابل اعتمادی را ترویج کنیم که به نفع جامعه است.

مسئولیت پذیری

همانطور که سیستم های هوش مصنوعی استقلال بیشتری به دست می آورند، اولویت دادن به مسئولیت پذیری و مسئولیت در توسعه و استقرار آنها بسیار مهم است. این شامل ایجاد سیاستها و رویههای واضح برای تعیین اینکه چه کسی مسئول اقدامات و تصمیمات اتخاذ شده توسط سیستمهای هوش مصنوعی است، میباشد. برای اطمینان از مسئولیت پذیری ، شرکت ها باید کنترل ها و تعادل ها و همچنین فرآیندهایی برای شناسایی و رسیدگی به هر گونه مشکلی که ممکن است ایجاد شود، داشته باشند. این شامل نظارت و ارزیابی مداوم عملکرد سیستم هوش مصنوعی و همچنین ارتباطات شفاف در مورد محدودیت ها یا خطرات بالقوه است. با اولویت دادن به مسئولیت پذیری ، می توانیم اطمینان حاصل کنیم که هوش مصنوعی به گونه ای استفاده می شود که به نفع کل جامعه باشد.

اعتماد و قابلیت اطمینان

آیا می توان به هوش مصنوعی اعتماد کرد؟ این سوالی است که بسیاری از مردم با رواج بیشتر هوش مصنوعی در زندگی ما می پرسند. برای اطمینان از اعتماد به سیستم های هوش مصنوعی، قابلیت اطمینان و دقت بسیار مهم است. هوش مصنوعی قبل از استقرار باید کاملاً آزمایش و تأیید شود و توسعه دهندگان باید روشهای آزمایش و اعتبارسنجی مناسب را برای رسیدن به این هدف پیادهسازی کنند. یکی از روشهای مؤثر استفاده از تست شخص ثالث مستقل است که میتواند هر مشکلی را شناسایی کرده و عملکرد کلی سیستمهای هوش مصنوعی را بهبود بخشد. بهعلاوه، نظارت و بهروزرسانی سیستمهای هوش مصنوعی میتواند به اطمینان حاصل شود که در طول زمان قابل اعتماد و دقیق باقی میمانند.

در نهایت، ایجاد اعتماد در هوش مصنوعی برای باز کردن پتانسیل کامل آن و اطمینان از سودمندی آن برای جامعه ضروری است.

کنترل انسان

این را تصور کنید: یک سیستم هوش مصنوعی شیطانی که اختیار تصمیم گیری خود را به دست آورده است. تصمیم می گیرد که بهترین راه برای بهبود جریان ترافیک این است که همه ماشین ها را به سمت پارک شهر هدایت کنند. هرج و مرج رخ می دهد و ناظران انسانی برای به دست آوردن مجدد کنترل تلاش می کنند.

به همین دلیل است که کنترل انسان در اخلاق هوش مصنوعی بسیار مهم است. همانطور که سیستمهای هوش مصنوعی پیشرفته هستند، برای اطمینان از استفاده مسئولانه از آنها به نظارت انسانی نیاز دارند. توسعه دهندگان باید نحوه تعامل انسان با سیستم های هوش مصنوعی و طراحی رابط های مناسب برای ورودی های انسانی را در نظر بگیرند. آنها همچنین باید مرزهای مشخصی را برای سیستم های هوش مصنوعی تعیین کنند و اطمینان حاصل کنند که در این محدوده های از پیش تعریف شده عمل می کنند. به طور خلاصه، انسان ها باید کنترل سیستم های هوش مصنوعی را برای جلوگیری از بلایای احتمالی حفظ کنند.

اثرات اجتماعی و زیست محیطی

همانطور که هوش مصنوعی در مرکز قرار می گیرد، مهم است که تاثیر آن بر جامعه و محیط زیست را در نظر داشته باشید. سیستم های هوش مصنوعی نه تنها باید سودمند باشند بلکه باید از مردم و سیاره زمین نیز محافظت کنند. برای انجام این کار، توسعهدهندگان باید به دقت پیامدهای احتمالی سیستمهای هوش مصنوعی بر مشاغل، اقتصاد و محیطزیست را در مرحله طراحی ارزیابی کرده و به آن رسیدگی کنند.

علاوه بر این، سازمان ها باید در مورد تأثیرات اجتماعی و زیست محیطی سیستم های هوش مصنوعی آگاه باشند و برای کاهش هر گونه اثرات نامطلوب اقدام فوری انجام دهند.

درباره آزاده قجر

دکتری مهندسی پزشکی علم و صنعت ایران و علاقمند به حوزه سیگنال های حیاتی و هوش مصنوعی

مطالب مرتبط

-

تحول دیجیتال و هوش مصنوعی در صنعت

اردیبهشت ۲۲, ۱۴۰۳

-

چشم انداز صنعت و دانشگاه در عصر ...

اردیبهشت ۱۴, ۱۴۰۳

-

مسیر شغلی هوش مصنوعی و علم داده ...

اردیبهشت ۷, ۱۴۰۳

-

دست نامرئی هوش مصنوعی

اردیبهشت ۵, ۱۴۰۳

-

پنج نکته و ترفند برای یک ...

فروردین ۱۶, ۱۴۰۳

نوشتههای تازه

- از خودکار بودن تا خودکامگی هوش مصنوعی اردیبهشت ۲۳, ۱۴۰۳

- تحول دیجیتال و هوش مصنوعی در صنعت اردیبهشت ۲۲, ۱۴۰۳

- چشم انداز صنعت و دانشگاه در عصر هوش مصنوعی اردیبهشت ۱۴, ۱۴۰۳

- مسیر شغلی هوش مصنوعی و علم داده ( ایده تا محصول ) اردیبهشت ۷, ۱۴۰۳

- دست نامرئی هوش مصنوعی اردیبهشت ۵, ۱۴۰۳